5.3.4 图像分割

UNet 简介

本示例展示如何基于轻量化的 UNet 语义分割模型,结合 SpaceMiT 智算核实现高效的图像分割。模型可接受静态图像或视频流输入,输出为像素级语义标签(灰度图)及伪彩渲染图,通过 ROS2 发布分割结果,便于下游感知与控制模块调用。

该模型基于 Cityscapes 数据集 训练,采用 ONNX 格式部署,支持对城市道路场景中的典型要素(如人、车、道路、交通标志等)进行精准分割。

UNet 的典型应用场景有:

- 自动驾驶感知(道路/目标分割)

- 城市街景结构解析与数字地图构建

- 遥感图像地物分类与土地利用识别

- 医学图像分割(如器官、病灶)

- 工业检测中的缺陷识别与预处理

环境准备

安装依赖项

sudo apt install python3-opencv ros-humble-cv-bridge ros-humble-camera-info-manager \

ros-humble-image-transport python3-spacemit-ort

导入 ROS 2 环境

source /opt/bros/humble/setup.bash

查看支持的分割模型

通过以下命令查看已支持的图像分割模型配置路径:

ros2 launch br_perception infer_info.launch.py | grep 'segmentation'

输出示例:

- config/segmentation/unet.yaml

图片推理

准备输入图片

cp /opt/bros/humble/share/jobot_infer_py/data/segmentation/test_unet.jpg .

推理并保存图像结果

ros2 launch br_perception infer_img.launch.py \

config_path:='config/segmentation/unet.yaml' \

img_path:='./test_unet.jpg'

示例输出:

[INFO] [launch]: All log files can be found below /home/zq-pi/.ros/log/2025-05-26-09-45-18-005008-spacemit-k1-x-MUSE-Pi-board-5995

[INFO] [launch]: Default logging verbosity is set to INFO

[INFO] [infer_img_node-1]: process started with pid [5996]

[infer_img_node-1] Inference time: 4665.87 ms

[infer_img_node-1] The semantic segmentation results are saved in: seg_result.jpg

[infer_img_node-1] The semantic segmentation pseudo-color image is saved to seg_pseudo_color.png

[INFO] [infer_img_node-1]: process has finished cleanly [pid 5996]

输出文件包括:

- seg_result.jpg:原图与预测结果叠加图

- seg_pseudo_color.png:伪彩图(各语义类别以彩色编码表示)

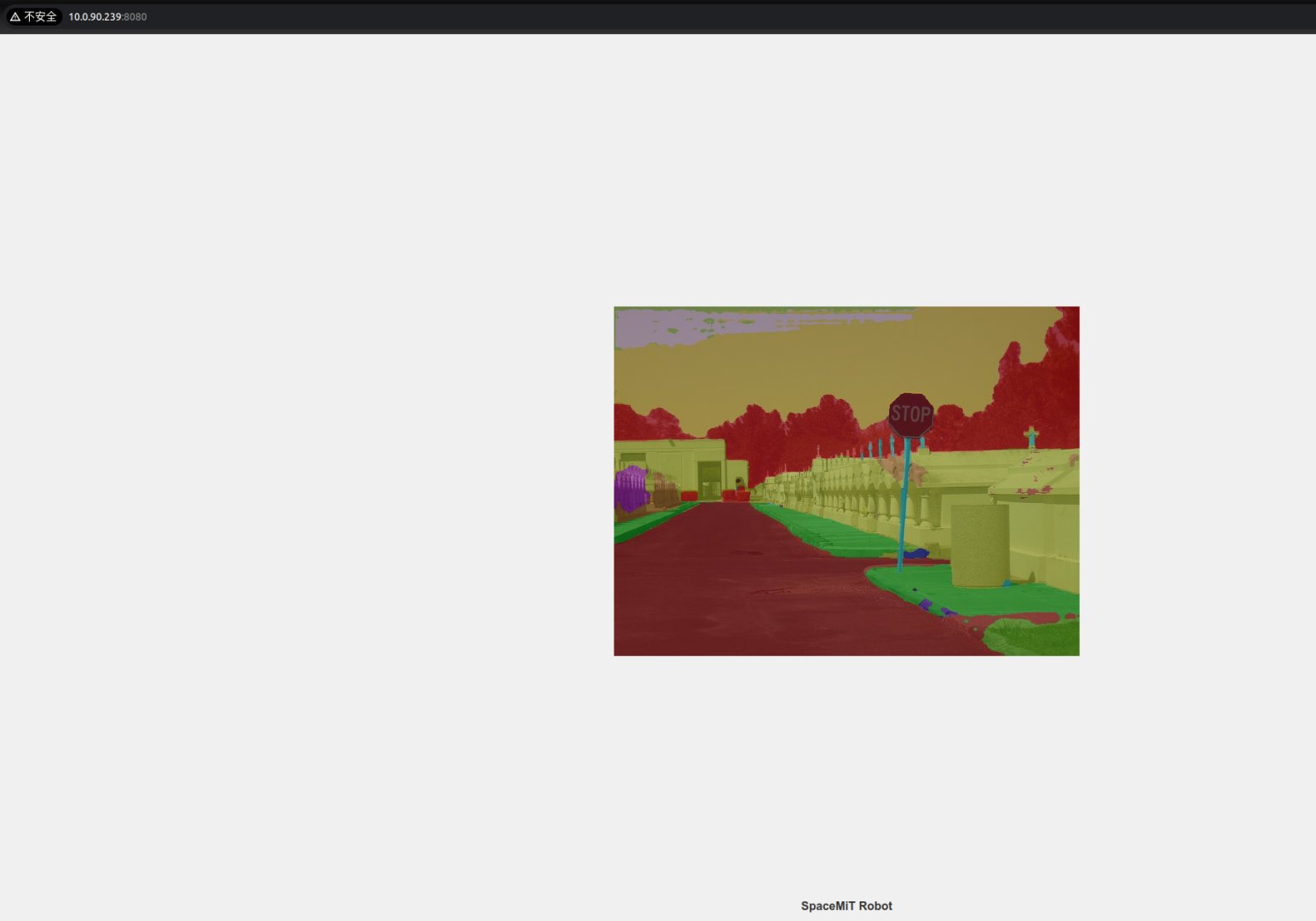

示例图:

| 原始图像 | 分割叠加图 | 伪彩图 |

|---|---|---|

|  |  |

Web 可视化推理结果

启动分割推理(终端1):

ros2 launch br_perception infer_img.launch.py \

config_path:='config/segmentation/unet.yaml' \

img_path:='./test_unet.jpg' \

publish_result_img:=true \

result_img_topic:='result_img' \

result_topic:='/inference_result'

终端1输出示例:

[INFO] [launch]: All log files can be found below /home/zq-pi/.ros/log/2025-05-26-10-05-41-203368-spacemit-k1-x-MUSE-Pi-board-7077

[INFO] [launch]: Default logging verbosity is set to INFO

[INFO] [infer_img_node-1]: process started with pid [7084]

[infer_img_node-1] Inference time: 4712.77 ms

[infer_img_node-1] The image inference results are published cyclically

[infer_img_node-1] The image inference results are published cyclically

[infer_img_node-1] The image inference results are published cyclically

启动 WebSocket 可视化服务(终端2):

ros2 launch br_visualization websocket_cpp.launch.py image_topic:='/result_img'

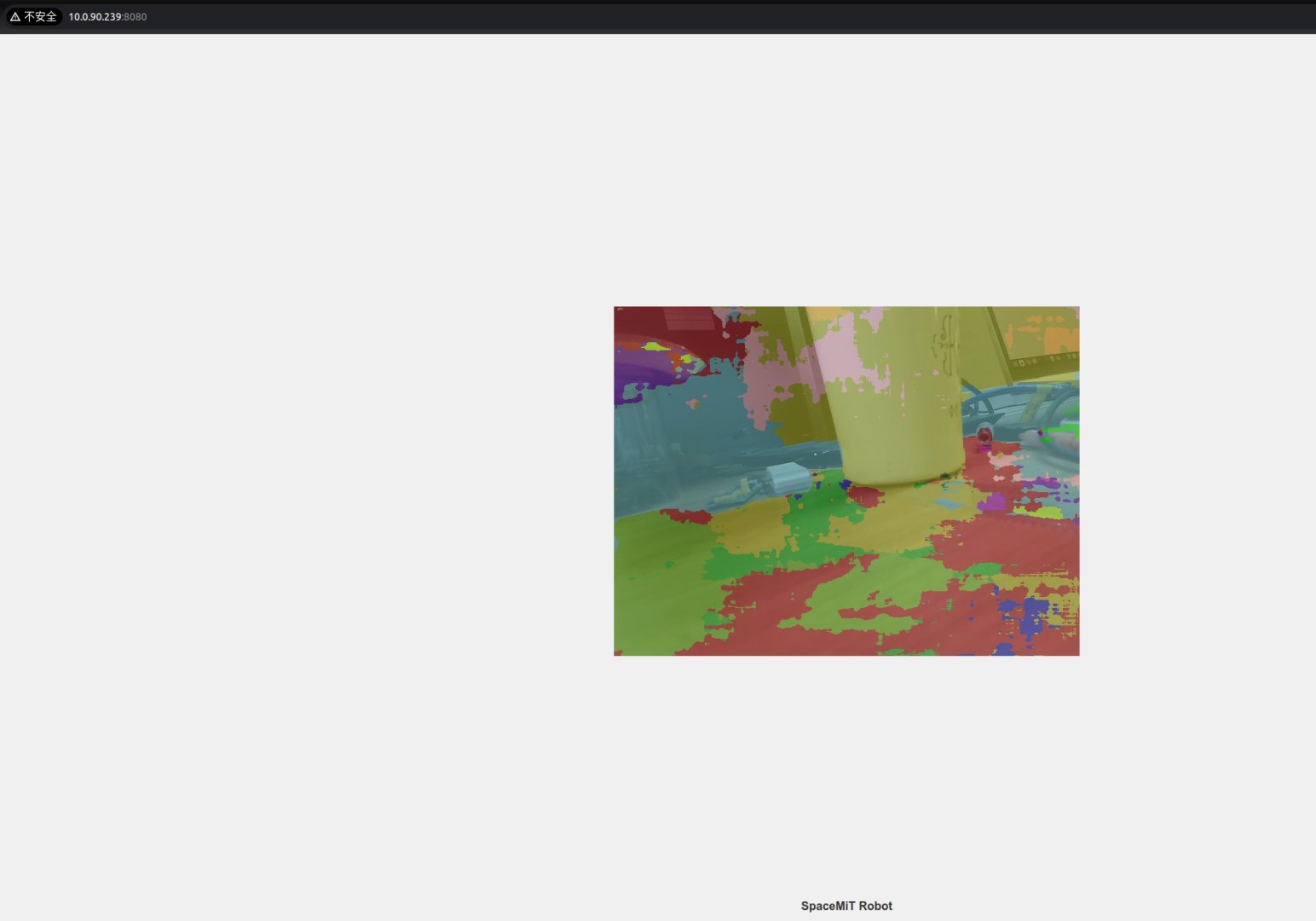

浏览器访问提示地址 http://<IP>:8080 以查看分割结果。

消息订阅和查看

result_topic:='/inference_result' 为推理结果发布的话题,你可以使用 ros2 topic echo /inference_result 命令查看

header:

stamp:

sec: 0

nanosec: 0

frame_id: ''

height: 480

width: 640

encoding: mono8

is_bigendian: 0

step: 640

data:

- 2

- 2

- 2

- 2

.....

消息格式定义为标准的 Image,编码格式为 mono8,为单通道灰度图,灰度值为像素的类别索引

按 Ctrl + C 可以结束下面这个终端命令运行:

ros2 launch br_perception infer_img.launch.py config_path:='config/segmentation/unet.yaml' img_path:='./test_unet.jpg' publish_result_img:=true result_img_topic:='result_img' result_topic:='/inference_result'

你可以换一张其它图片进行推理,改变 img_path 即可,web端的结果会进行更新。

infer_img.launch.py 的参数说明

| 参数名称 | 作用 | 默认值 |

|---|---|---|

| config_path | 配置推理时使用的模型 | config/detection/yolov6.yaml |

| img_path | 推理时使用的图片路径 | data/detection/test.jpg |

| publish_result_img | 是否以图像消息的形式发布推理结果 | false |

| result_img_topic | 发布的渲染图像消息名,publish_result_img为true时才有效 | /result_img |

| result_topic | 发布的推理结果消息名 | /inference_result |

视频流推理

启动摄像头设备

ros2 launch br_sensors usb_cam.launch.py video_device:="/dev/video20"

启动视频流分割

开启终端1,执行下述命令启动视频流分割:

ros2 launch br_perception infer_video.launch.py \

config_path:='config/segmentation/unet.yaml' \

sub_image_topic:='/image_raw' \

publish_result_img:=true \

result_topic:='/inference_result'

Web 可视化

开启终端2,执行下述命令可视化分割结果:

ros2 launch br_visualization websocket_cpp.launch.py image_topic:='/result_img'

终端打印如下

[INFO] [launch]: All log files can be found below /home/zq-pi/.ros/log/2025-05-26-10-24-14-851432-spacemit-k1-x-MUSE-Pi-board-9709

[INFO] [launch]: Default logging verbosity is set to INFO

[INFO] [websocket_cpp_node-1]: process started with pid [9717]

[websocket_cpp_node-1] Please visit in your browser: 10.0.90.239:8080

[websocket_cpp_node-1] [INFO] [1748226256.136463264] [websocket_cpp_node]: WebSocket Stream Node has started.

[websocket_cpp_node-1] [INFO] [1748226256.138754474] [websocket_cpp_node]: Server running on http://0.0.0.0:8080

[websocket_cpp_node-1] [INFO] [1748226257.018145047] [websocket_cpp_node]: WebSocket client connected.

浏览器访问提示地址 http://<IP>:8080 即可查看实时分割结果。

无可视化,仅获取语义分割结果

如无需 Web 显示,仅获取类别索引图:

ros2 launch br_perception infer_video.launch.py \

config_path:='config/segmentation/unet.yaml' \

sub_image_topic:='/image_raw' \

publish_result_img:=false \

result_topic:='/inference_result'

打印/inference_result话题:

header:

stamp:

sec: 0

nanosec: 0

frame_id: ''

height: 480

width: 640

encoding: mono8

is_bigendian: 0

step: 640

data:

- 2

- 2

- 2

- 2

.....

消息格式定义为标准的 Image,编码格式为 mono8,为单通道灰度图,灰度值为像素的类别索引

infer_video.launch.py 的参数说明

| 参数名称 | 作用 | 默认值 |

|---|---|---|

| config_path | 配置推理时使用的模型 | config/detection/yolov6.yaml |

| sub_image_topic | 订阅的图像消息话题名 | /image_raw |

| publish_result_img | 是否以图像消息的形式发布推理结果 | false |

| result_img_topic | 发布的渲染图像消息名,publish_result_img为true时才有效 | /result_img |

| result_topic | 发布的推理结果消息名 | /inference_result |